La rápida evolución de la Inteligencia Artificial (IA) ha impulsado iniciativas mundiales y nacionales encaminadas a establecer un marco de gobernanza de la IA responsable y seguro.

Recientemente, destacadas entidades mundiales como el Grupo de los Siete (G7) y las Naciones Unidas (ONU) han dado a conocer planes para guiar el crecimiento de la IA, cada uno de ellos con puntos focales distintos.

Mientras que el G7 está orientado hacia unas directrices claras, la ONU pretende iniciar un diálogo mundial sobre el uso responsable de la IA.

Mientras tanto, países como Estados Unidos y el Reino Unido están dando un paso adelante con sus propias estrategias, como se puede ver en la orden ejecutiva de Estados Unidos sobre la gobernanza de la IA y en la actual Cumbre de Seguridad de la IA del Reino Unido, que muestran una mezcla de colaboración mundial y acción nacional para navegar por el panorama de la IA.

Este artículo profundiza en estos importantes esfuerzos mundiales y nacionales, explorando sus objetivos, marcos y la sinergia entre ellos.

El G7 y las Naciones Unidas lanzan directrices para el desarrollo y uso seguro de la IA

El G7 y el uso responsable de la IA

A medida que el panorama tecnológico de la IA evoluciona rápidamente, las naciones de todo el mundo están haciendo planes para gestionarla de forma segura. Quieren sacar el máximo partido de la IA sin dejar de examinar los riesgos.

Recientemente, el G7, un grupo de siete países ricos, y la ONU han dado a conocer planes para gestionar el crecimiento de la IA. Mientras que el G7 se centra en establecer directrices claras, la ONU quiere iniciar un diálogo mundial para el uso responsable y beneficioso de la IA.

A continuación, analizaremos el Proceso de IA de Hiroshima del G7 y el grupo asesor de IA de la ONU, mostrando cómo estos grandes actores se están preparando para un futuro impulsado por la IA.

El 30 de octubre de 2023, los líderes del Grupo de los Siete (G7) revelaron un plan denominado Proceso de IA de Hiroshima para gestionar el crecimiento de la IA de forma segura. He aquí un desglose de su proyecto:

- Objetivo: aprovechar el potencial de la IA controlando los riesgos.

- Novedades: se introducen principios rectores internacionales y un código de conducta para las organizaciones que desarrollen sistemas avanzados de IA.

- Marco político: A finales de año se creará un plan detallado que incluirá las aportaciones de diversos grupos, como gobiernos, escuelas y empresas. Este proceso de divulgación y consulta pretende implicar no sólo a los países del G7, sino también a otros países de todo el mundo.

Puntos clave del Proceso de Hiroshima

- Responsabilidad y transparencia

Se insta a las organizaciones a ser transparentes sobre las capacidades y limitaciones de sus sistemas de IA. - Un llamamiento a la información pública para garantizar que todo el mundo sepa lo que los sistemas de IA pueden y no pueden hacer.

Gestión de riesgos

- Identificar y abordar los riesgos en una fase temprana del desarrollo de los sistemas de IA.

- Se recomiendan medidas de seguridad estrictas para proteger los datos.

Autenticación de contenidos

- Desarrollar formas de ayudar a los usuarios a identificar los contenidos generados por IA, como las marcas de agua.

Afrontar los retos mundiales

- Se anima a utilizar la IA para abordar problemas importantes como el cambio climático, la salud y la educación.

Mejora continua

- Las directrices no son inamovibles, sino que evolucionarán con los debates en curso y los cambios tecnológicos.

Cooperación internacional

- Colaborar con otros países y organizaciones para establecer normas y prácticas comunes.

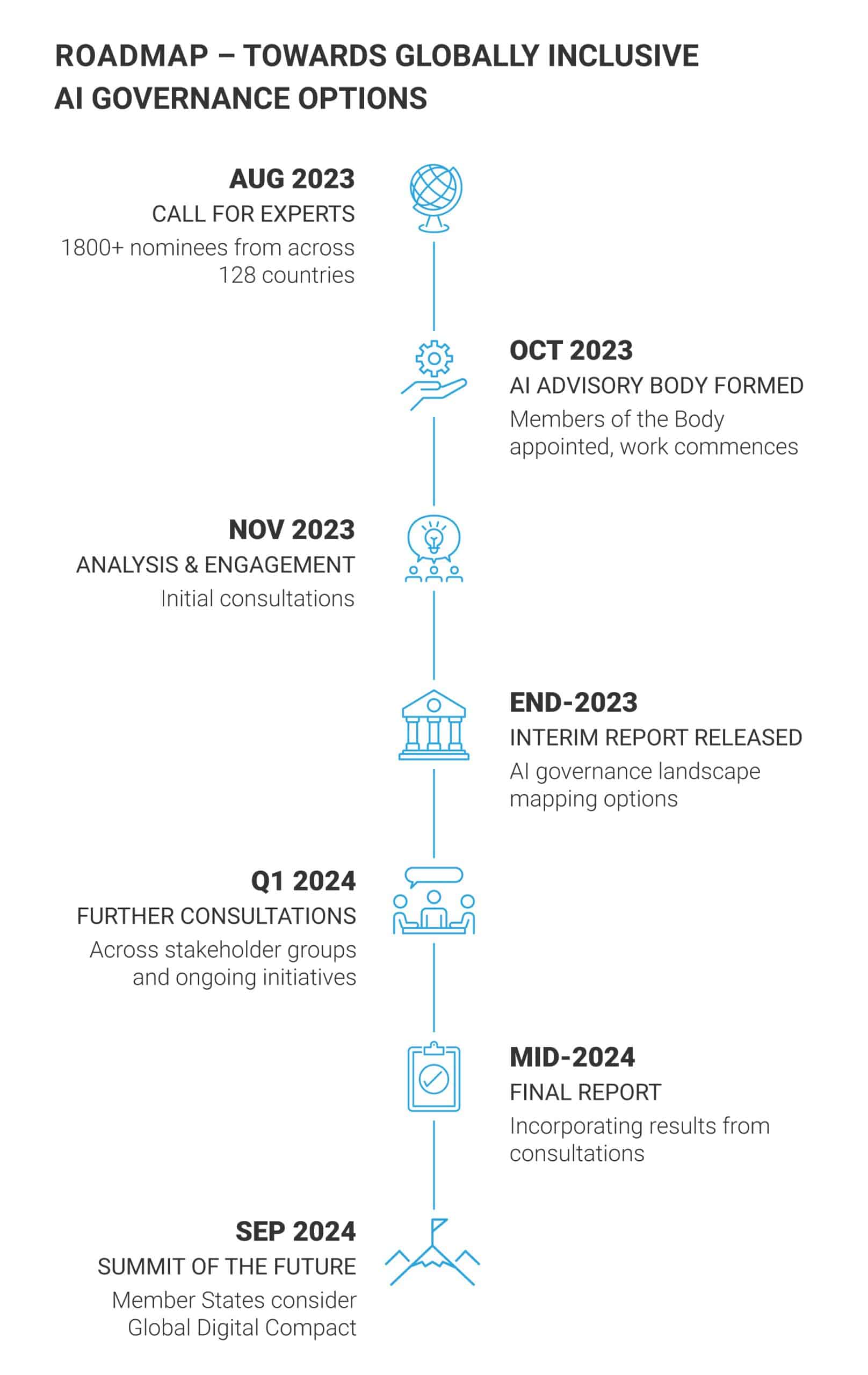

Marco consultivo de las Naciones Unidas sobre IA

El 26 de octubre de 2023, justo antes de que el G7 presentara el Proceso de IA de Hiroshima, el Secretario General de las Naciones Unidas anunció la creación de un órgano consultivo denominado Órgano Consultivo Multilateral de Alto Nivel sobre Inteligencia Artificial.

Este órgano consultivo pretende utilizar la IA de forma responsable para ayudar a resolver problemas mundiales y garantizar que todos los países, incluidos los menos desarrollados, puedan acceder a la tecnología de IA.

He aquí un rápido vistazo a la nueva iniciativa de la ONU sobre IA:

- Objetivo: Utilizar la IA para ayudar a afrontar retos mundiales como el cambio climático y alcanzar los Objetivos de Desarrollo Sostenible (ODS) para 2030.

Principales puntos de interés:

- Gobernanza de la IA: Iniciar debates mundiales sobre cómo gobernar la IA para obtener los máximos beneficios y reducir los riesgos.

- Comprender los riesgos y desafíos: Examinar y abordar los posibles peligros de la IA, como la desinformación y la invasión de la privacidad.

- Utilizar la IA para el bien: Encontrar formas de utilizar la IA en áreas esenciales como la salud pública y la educación para acelerar la consecución de los ODS.

Próximos pasos: Para finales de 2023, el órgano consultivo tiene previsto ofrecer sugerencias iniciales en estas tres áreas a través de un informe provisional. Este informe alimentará la Cumbre del Futuro que se celebrará en septiembre de 2024.

Perspectivas comparadas: Iniciativas del G7 y de la ONU

El G7 y la ONU han lanzado planes para gestionar el crecimiento de la IA de forma segura, pero con enfoques ligeramente diferentes. El G7 se centra más en establecer normas claras, mientras que la ONU quiere iniciar un debate mundial sobre el uso y la gobernanza de la IA.

He aquí una tabla comparativa de ambos enfoques:

| G7 Hiroshima AI Process | UN’s Advisory Body on AI |

|---|---|

| Tiene como objetivo crear reglas para el desarrollo y uso seguro de la IA | Planea investigar y abordar posibles riesgos de la IA, como la difusión de información falsa |

| Espera trabajar con otros países para establecer prácticas comunes | Quiere iniciar conversaciones globales sobre la gobernanza de la IA para beneficiar a todos y reducir riesgos |

| Quiere que las organizaciones sean claras sobre lo que sus sistemas de IA pueden hacer | Aspira a usar la IA para ayudar con problemas globales como la salud y la educación |

| Fomenta abordar los riesgos temprano y mantener los datos seguros | Compartirá ideas iniciales a finales de año, aportando a una gran cumbre el próximo septiembre |

De lo mundial a lo nacional: Dirigir la gobernanza de la IA

Mientras el G7 y la ONU dirigen la narrativa global sobre la gobernanza de la IA, las naciones individuales también están asumiendo el reto.

Estados Unidos y el Reino Unido, ambos actores clave en el campo de la IA, han lanzado recientemente iniciativas para dar forma a la gobernanza de la IA.

Los EE.UU. han esbozado su enfoque a través de una orden ejecutiva del Presidente Biden, mientras que el Reino Unido acogerá la Cumbre de Seguridad de la IA los días 1 y 2 de noviembre de 2023.

A través de estas acciones, ambos países contribuyen a la conversación global sobre IA, aportando sus perspectivas nacionales únicas para ayudar a construir un marco de gobernanza global de IA más fuerte y completo.

Orden ejecutiva de EE.UU. sobre la gobernanza de la IA

La orden ejecutiva establece un marco para gestionar los riesgos de la IA, exigiendo a los principales desarrolladores de IA que compartan información crucial con el gobierno antes de su lanzamiento.

Esta orden, una de las primeras normativas gubernamentales sobre IA, establece normas para la seguridad de la IA, aborda los riesgos potenciales de la IA y promueve la innovación, al tiempo que garantiza el uso responsable de la IA en diversos sectores.

Entre las principales disposiciones figuran la obligación de compartir los resultados de las pruebas de seguridad de los sistemas avanzados de IA, la realización de pruebas exhaustivas para los modelos de IA que planteen riesgos graves y el desarrollo de un programa de ciberseguridad para aprovechar la IA en la identificación de vulnerabilidades del software.

La reacción a esta orden ha sido variada: los grupos de defensa han valorado positivamente la iniciativa, mientras que algunos agentes del sector han expresado su preocupación por la posibilidad de que se ahogue la innovación.

Para una comprensión más profunda, consulte nuestro artículo de resumen en profundidad de la Orden Ejecutiva.

Iniciativa del Reino Unido: La Cumbre sobre Seguridad de la IA

La Cumbre sobre Seguridad de la IA ha reunido a destacados expertos del mundo académico, la industria y la administración para profundizar en los aspectos críticos de la seguridad de la IA en las fronteras del conocimiento.

La IA de frontera se define como modelos competentes de IA de propósito general que pueden realizar una amplia variedad de tareas e igualar o superar las capacidades presentes en los modelos más avanzados de la actualidad. En 2023, esto incluye principalmente los grandes modelos de lenguaje (LLM), pero una tecnología diferente podría sustentar los sistemas de IA de frontera.

Los debates abarcaron un amplio espectro de temas, como las prácticas éticas de la IA, la privacidad de los datos y el establecimiento de sólidos protocolos de seguridad para el desarrollo y despliegue de la IA.

Participantes clave:

- Gobiernos de 27 países diferentes

- Grupos académicos y de la sociedad civil

- Industria y organizaciones afines

- Organizaciones multilaterales

He aquí un resumen del orden del día de la Cumbre de Seguridad de la IA del Reino Unido:

Comprender los riesgos fronterizos de la IA

- Seguridad global: Debate sobre los riesgos del uso indebido de la IA de frontera para la bioseguridad y la ciberseguridad.

- Avances impredecibles: Deliberar sobre los riesgos derivados de la rápida ampliación y los avances impredecibles de las capacidades de la IA de frontera.

- Pérdida de control: Exploración de la posible pérdida de control humano sobre la IA muy avanzada y sus riesgos.

- Integración en la sociedad: Debatir los riesgos de integrar la IA de frontera en marcos sociales, como las elecciones, y las medidas para mitigarlos.

Mejorar la seguridad de la IA de frontera

- Responsabilidad de los desarrolladores: Debates sobre la ampliación responsable de capacidades por parte de los desarrolladores de IA de frontera, incluidas las evaluaciones de riesgos y los mecanismos de gobernanza.

- Elaboración de políticas nacionales: Deliberación sobre políticas para gestionar los riesgos de la IA de frontera, incluidos mecanismos de supervisión y rendición de cuentas.

- Colaboración internacional: Identificar áreas de colaboración internacional para gestionar los riesgos y aprovechar las oportunidades de la IA de frontera.

- Papel de la comunidad científica: Debatir el estado actual de las soluciones técnicas para la seguridad de la IA en las fronteras e identificar áreas de investigación urgentes.

IA para el bien

Transformar la educación: Debate sobre las oportunidades de la IA para transformar la educación de las generaciones futuras.

Lo esencial

La narrativa de la gobernanza de la IA se está desarrollando en escenarios tanto globales como nacionales, mostrando un esfuerzo colectivo para maximizar los beneficios de la IA al tiempo que se controlan sus riesgos.

Las iniciativas del G7 y de la ONU encarnan un enfoque global, estableciendo un amplio marco e iniciando debates internacionales. Mientras tanto, EE.UU. y el Reino Unido están dando sus propios pasos decisivos, alineándose con estos diálogos globales.

A medida que la IA siga creciendo, la colaboración entre los esfuerzos mundiales y locales será crucial para guiar la gobernanza de la IA hacia un futuro seguro, responsable y beneficioso para todos.

Este esfuerzo conjunto, en el que cada uno aporta su propia visión, es vital para garantizar que la IA beneficie a la humanidad al tiempo que se reducen los riesgos que conlleva.